Daftar Isi:

- Pengarang John Day day@howwhatproduce.com.

- Public 2024-01-30 09:54.

- Terakhir diubah 2025-06-01 06:09.

Oleh sharathnaikSharathnaik.comIkuti Lainnya oleh penulis:

Tentang: Teknik dan Desain Lebih Lanjut Tentang sharathnaik »

Saya baru-baru ini menemukan diri saya menonton banyak serial Netflix karena situasi saat ini, saya harap Anda semua aman, dan saya melihat musim 5 dari Black Mirror dirilis. Serial antologi yang berkisah tentang sekelompok kehidupan pribadi orang dan bagaimana teknologi memanipulasi perilaku mereka.

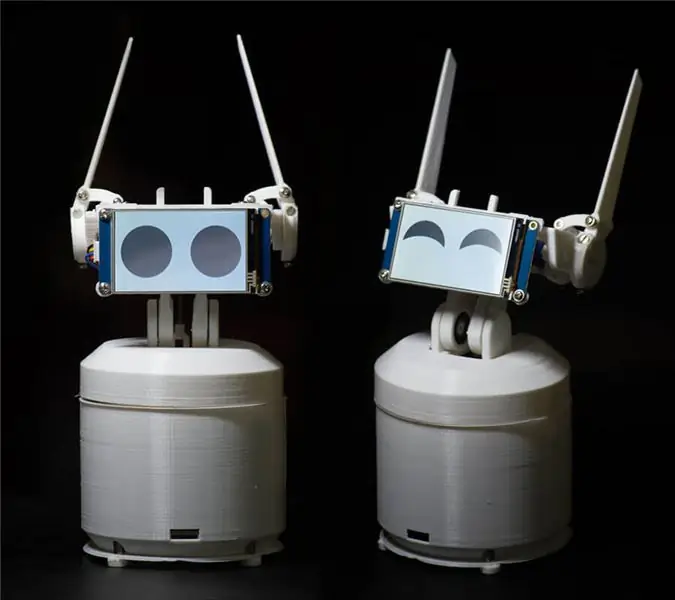

Dan salah satu episode yang menarik perhatian saya adalah Rachel, Jack, dan Ashley Too. Salah satu karakter utama dari seri ini adalah robot rumahan bernama Ashley O dan robot itu memiliki banyak karakter di sekitarnya dan saya pikir saya harus membangunnya, ini adalah proyek yang bagus untuk memulai pemrograman jika tidak maka setidaknya Saya dapat memprogramnya untuk menertawakan lelucon saya.!

Apa / Siapa Ewon? Apa yang bisa dilakukan?

Jadi sebelum saya mulai mengerjakan proyek ini, saya menetapkan beberapa aturan dasar yang harus diikuti. Proyek ini harus

- Mudah untuk dicoba semua orang

- Bukan hanya sekedar lucu tapi juga berguna agar tidak berakhir di rak

- Modular, sehingga Anda dapat terus menambahkan fitur baru.

Setelah menetapkan aturan ini, saya memutuskan untuk menggunakan Google Assistant SDK. SDK ini menyediakan banyak fitur yang saya cari dan jika Anda bosan dengan Ewon, Anda selalu menggunakannya sebagai perangkat Google Home dan melakukan apa yang dilakukan Google Home.

Apa yang akan dilakukan Ewon adalah menambahkan karakter ke asisten Google. Itu menunjukkan emosi dan bereaksi terhadap apa yang dikatakan pengguna. Sekarang bukan hanya suara yang Anda dengar tetapi Anda juga bisa melihat bagaimana harus bereaksi.

CATATAN: Instruksi ini sedang dalam pengembangan. Saya akan segera mengunggah semua file yang relevan. Terima kasih

Langkah 1: Bagian Diperlukan untuk Ewon

ELEKTRONIK

- PI raspberry

- Servo SG90 (x4)

- Servo MG995 - standar (x2)

- Driver Servo 16-Saluran PCA9685

- kartu suara USB

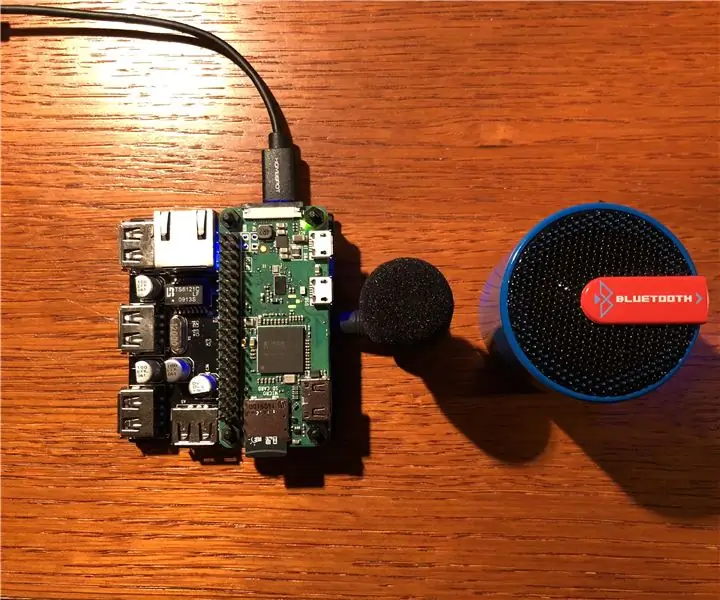

- Mikropon

- Pembicara (Speaker kecil mana pun akan melakukannya, sesuatu seperti ini)

- Konektor header pin pria dan wanita

- Papan tempat memotong roti

- Tampilan Berikutnya

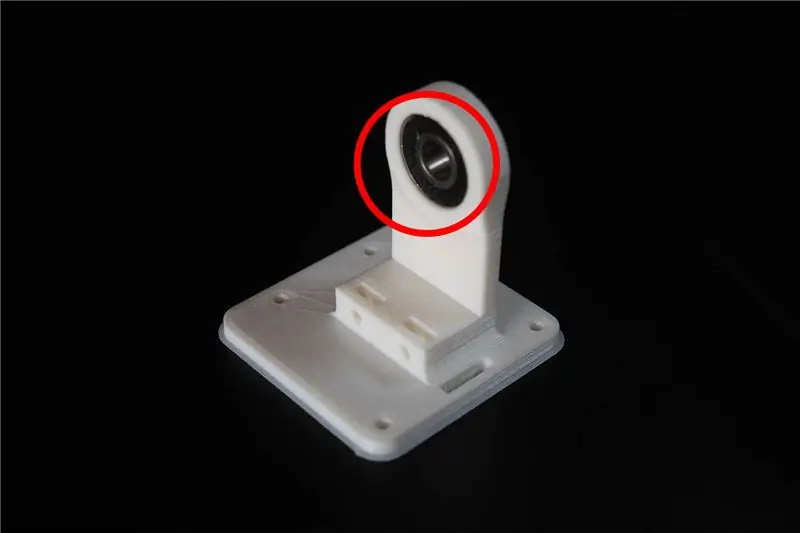

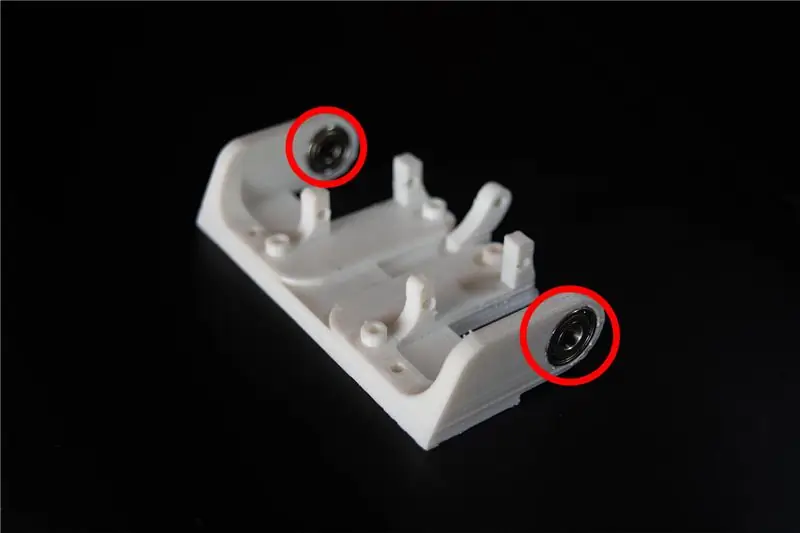

PENGIKAT DAN BEARING

- M3 * 10mm (x10)

- M3*8mm (x10)

- Kacang M3 (x20)

-

bantalan

- OD: 15mm ID: 6mm Lebar: 5mm (x2)

-

OD: 22mm ID: 8mm Lebar: 7mm (x2)

BAHAN LAINNYA

-

Kebuntuan

- 40mm (x4)

- 30mm (x4)

PERALATAN

pencetak 3D

Langkah 2: Memahami Ewon dan Pemrograman

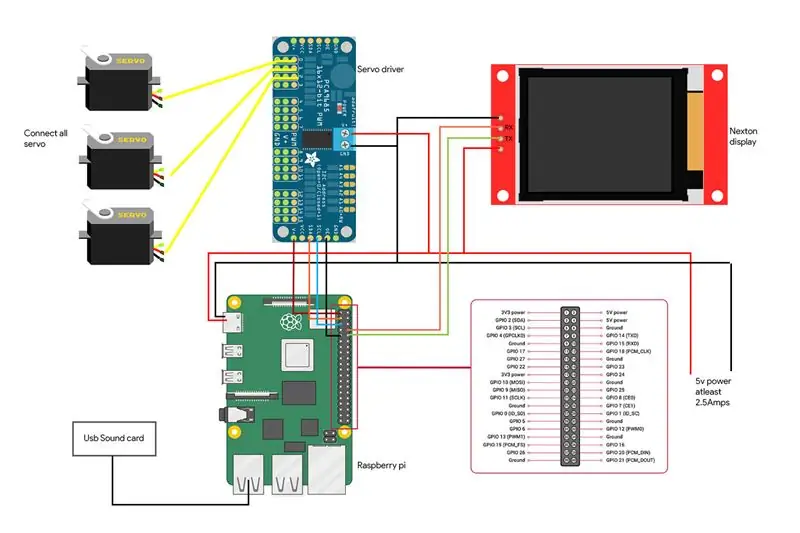

Sebelum saya mulai dengan aspek pemrograman izinkan saya menjelaskan secara singkat diagram blok sirkuit Ewon.

RPI (Raspberry pi) adalah otak dari sistem. Driver servo yang dikendalikan oleh RPI menggerakkan servo. Tampilan dikendalikan oleh RPI dengan komunikasi serial untuk menunjukkan emosi dan terakhir, mic dan speaker digunakan untuk berkomunikasi dengan Ewon. Sekarang kita tahu perangkat keras apa yang melakukan apa, mari kita mulai memprogram Ewon.

Memasang SDK asisten google

Izinkan saya menjelaskan dua alasan mengapa saya berencana menggunakan Asisten Google:

- Saya ingin Ewon tidak hanya menjadi robot yang menyenangkan tetapi juga berguna. Google Assistant SDK sudah memiliki banyak sumber daya yang dapat Anda gunakan untuk meningkatkan fungsionalitas Ewon.

- Anda juga dapat menggunakan tindakan di google dan alur dialog untuk memberi Ewon kemampuan untuk mengobrol dengan tanggapan yang telah ditentukan sebelumnya. Untuk saat ini, kami hanya akan berkonsentrasi pada SDK dasar.

Mari kita mulai dengan menginstal Google Assistant SDK. Ini seharusnya tidak sulit karena ada banyak sumber daya untuk membantu Anda menyiapkan Google Assistant SDK di RPI. Anda dapat mengikuti tutorial ini bersama:

Tutorialnya:

Setelah proses di atas berakhir, Anda seharusnya dapat mengklik enter pada keyboard dan berbicara dengan asisten. Itu saja tentang menginstal Google Assistant SDK.

Apa yang harus saya beri nama? Ewon?

Hai Google! Itulah yang digunakan untuk mulai berbicara dengan asisten google dan sayangnya google tidak mengizinkan kata bangun khusus lainnya untuk digunakan. Jadi mari kita lihat bagaimana kita dapat mengubah ini sehingga asisten google terpicu ketika seseorang memanggil Ewon.

Snowboy: mesin pendeteksi kata panas yang sangat dapat disesuaikan yang tertanam secara real-time yang kompatibel dengan Raspberry Pi, (Ubuntu) Linux, dan Mac OS X.

Kata panas (juga dikenal sebagai kata bangun atau kata pemicu) adalah kata kunci atau frasa yang terus-menerus didengarkan oleh komputer sebagai sinyal untuk memicu tindakan lain.

Mari kita mulai dengan menginstal Snowboy di RPI. Ingatlah untuk mengaktifkan lingkungan virtual untuk menginstal Snowboy seperti yang Anda lakukan untuk menginstal Asisten SDK. Segala sesuatu yang kita instal dari sini harus diinstal di lingkungan virtual. Memasang Snowboy bisa sedikit rumit tetapi tautan ini akan membantu Anda memasangnya tanpa masalah. Tautan:

Berikut ringkasan proses instalasi jika tautan di atas membingungkan atau instalasi gagal.

$ [sudo] apt-get install libatlas-base-dev swig$ [sudo] pip install pyaudio $ git clone https://github.com/Kitt-AI/snowboy $cd snowboy/swig/Python3 $ make $cd.. /.. $ python3 setup.py build $ [sudo] python setup.py install

Setelah Diinstal, jalankan file demo [ditemukan di folder - snowboy/examples/Python3/] untuk melihat apakah semuanya berfungsi dengan baik.

Catatan: Anda dapat dengan mudah mengubah nama robot Anda menjadi sesuatu yang lain juga. Yang harus Anda lakukan adalah pergi ke https://snowboy.kitt.ai/ dan melatih kata cepat khusus dan kemudian menempatkan kata panas itu di folder yang sama dengan ewon.pmdl.

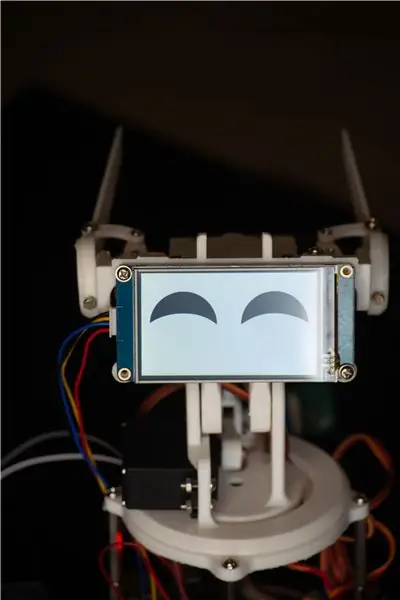

Bisakah Ewon memahami emosi?

Sekarang Ewon memiliki nama, saya akan menggunakan Ewon daripada menyebutnya robot. Oke jadi emosi, jawaban singkat tidak, Ewon tidak bisa memahami emosi jadi apa yang akan kita lakukan di sini adalah membuat Ewon mendeteksi emosi dalam ucapan kita menggunakan kata kunci dan kemudian memainkan ekspresi wajah yang sesuai yang terkait dengannya.

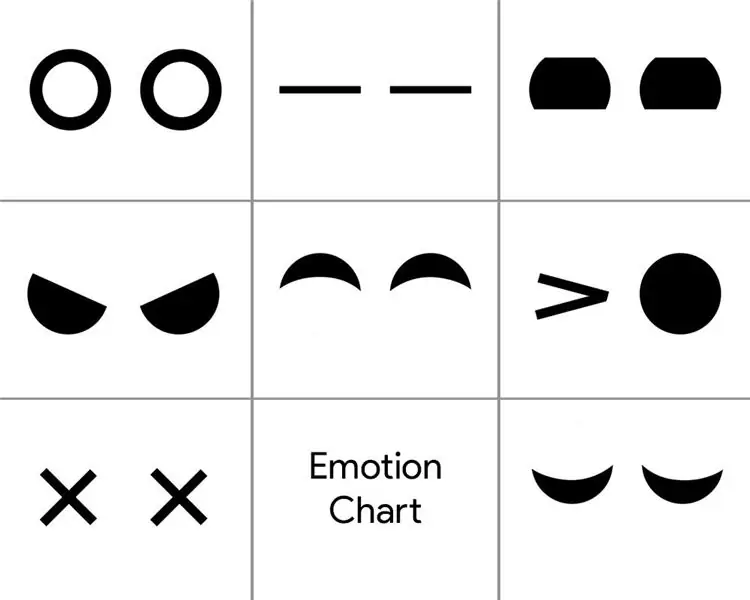

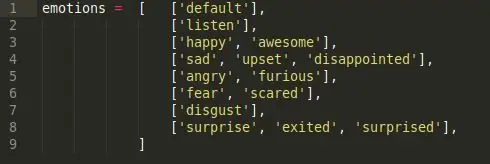

Untuk mencapai ini, apa yang telah saya lakukan adalah skrip analisis sentimen sederhana. Ada 6 kelas emosi yang berbeda.

Senang, Sedih, Marah, Takut, Jijik, dan Kejutan. Ini adalah kelas emosi utama dan masing-masing memiliki daftar kata kunci yang terkait dengan emosi. (misalnya baik, baik, bersemangat, semua berada di bawah emosi bahagia).

Jadi, setiap kali kita mengucapkan salah satu kata kunci di kelas emosi, emosi yang sesuai akan terpicu. Jadi ketika Anda mengatakan "Hei Ewon!" dan menunggu Ewon untuk berbicara dan saya melanjutkan mengatakan "Hari ini adalah hari yang menyenangkan!", ia mengambil kata kunci "Bagus" dan memicu emosi yang sesuai 'Happy' yang memicu ekspresi wajah untuk Happy.

Apakah telinga itu pada Ewon?

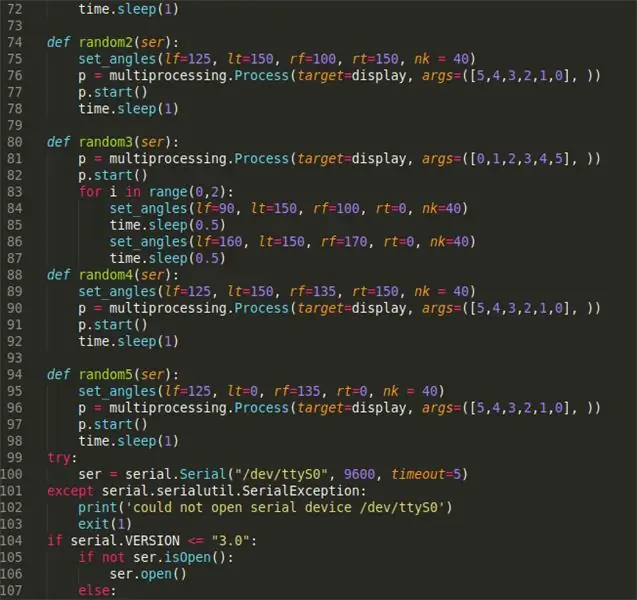

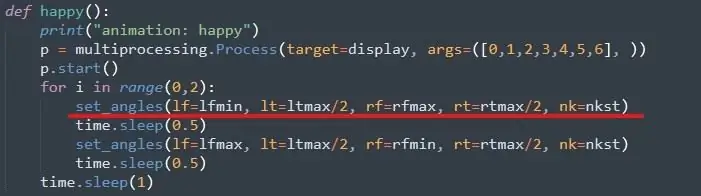

Langkah selanjutnya adalah menggunakan emosi yang dipicu untuk menjalankan ekspresi wajah masing-masing. Dengan Ewon, ekspresi wajah diperhatikan tetapi menggerakkan telinga dan lehernya menggunakan servos dan mengubah tampilan untuk mengubah gerakan mata.

Pertama, servos, untuk menjalankannya cukup mudah Anda bisa mengikuti tutorial ini untuk mengatur library servo Adafruit. Tautan:

Kemudian kami menetapkan nilai maksimum dan minimum untuk semua servos. Ini dilakukan dengan menggerakkan setiap servo secara manual dan memeriksa batasnya. Anda dapat melakukan ini setelah Anda mengumpulkan Ewon.

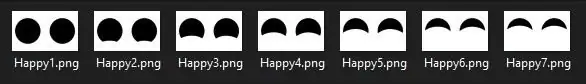

Mata untuk Ewon

Untuk mata, saya menggunakan tampilan Nextion yang memiliki banyak gambar seperti di bawah ini.

Ini adalah urutan gambar yang saya desain di photoshop yang ketika diputar secara berurutan membuat animasi. Urutan serupa dibuat untuk semua emosi. Sekarang untuk menampilkan emosi apa pun yang harus Anda lakukan adalah memanggil urutan gambar tertentu yang membentuk animasi. File-file tersebut berada di dalam folder 'Display files', link download di bawah ini.

Akhirnya

Menyatukan semuanya ketika emosi bahagia dipicu oleh skrip, fungsi bahagia dipanggil dan servo bergerak ke sudut yang sudah diatur dan tampilan memainkan animasi mata bahagia. Jadi beginilah cara kita mencapai "pemahaman" tentang emosi manusia. Metode ini bukan yang terbaik dan ada kalanya kata kunci tidak memiliki emosi yang sama seperti yang telah ditentukan sebelumnya, tetapi untuk saat ini, ini berfungsi cukup baik dan Anda selalu dapat menambahkan lebih banyak kata kunci untuk meningkatkan akurasi deteksi. Selanjutnya, ini dapat diganti dengan model analisis emosi yang jauh lebih terlatih seperti model analisis Emosi Paraleldot untuk mendapatkan hasil yang lebih baik. Tapi ketika saya mencobanya ada banyak penundaan yang akan membuat Ewon bereaksi lebih lambat. Mungkin Ewon versi 2.0 akan ada yang seperti ini.

Ini adalah LINK ke semua file yang dibutuhkan untuk menjalankan EWON. Unduh file dan ikuti langkah-langkah di bawah ini:

- Unzip file tempat folder ini (Ewon) di home/pi/

- Tambahkan Device Id dan Model ID di file main.py. ID diperoleh saat menginstal Google Assistant SDK.

- Buka command prompt dan jalankan sumber dari perintah berikut:

sumber env/bin/activatepython main.py models/Ewon.pmdl

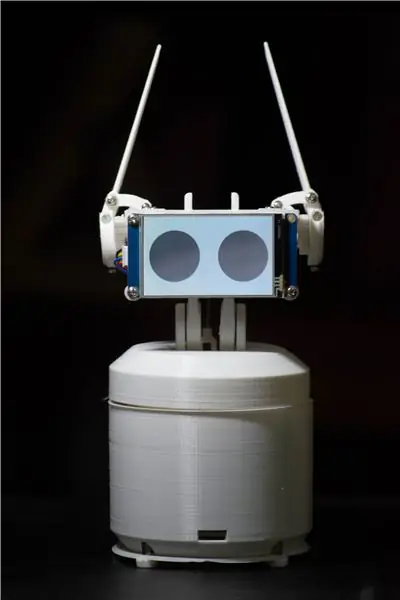

Langkah 3: Mencetak Tubuh

Anda dapat menemukan file 3d di sini:

Sekarang kita semua sudah siap dengan otak Ewon saatnya untuk mencetak tubuhnya. Ada 18 bagian unik yang akan dicetak, sebagian besar berukuran cukup kecil, dengan total waktu cetak sekitar 15-20 jam. (tidak termasuk kasus).

Saya menggunakan PLA putih dengan pengisi 50% dan tinggi lapisan 2mm. Anda dapat mengubah nilai-nilai ini jika diperlukan, itu akan berfungsi dengan baik tetapi pastikan bahwa bagian-bagian kecil memiliki pengisi 100%, untuk kekuatan.

Setelah file dicetak, Anda dapat menggunakan amplas atau file tangan dan membersihkan bagian yang dicetak terutama tautan di mana bagian-bagian tersebut saling bergesekan. Menghaluskan sambungan akan membuat mekanisme menjadi halus dan akan memberikan sedikit hambatan pada servo. Proses ini bisa memakan waktu selama yang Anda inginkan karena seseorang bisa tersesat saat mencoba membuat bagian yang dicetak terlihat sempurna.

Catatan tambahan: Anda dapat mengebor ulang lubang di bagian cetakan 3d menggunakan mata bor 3mm. Semua lubang memiliki dimensi yang sama. Ini akan membuatnya lebih mudah saat memasang mur nanti di rakitan.

Langkah 4: Menyatukan Ewon

Sebelum kita mulai dengan perakitan, ada beberapa modifikasi yang diperlukan untuk bagian yang dicetak. File bernama servo link harus dilengkapi dengan servo link yang disertakan dengan servo, ini membuat link cetak 3d untuk terhubung dengan baik dengan servo.

Perakitan Ewon harus lurus ke depan. Saya telah melampirkan gambar untuk Anda ikuti.

Catatan tambahan: Pastikan Anda tidak mengencangkan baut atau sekrup secara berlebihan karena dapat merusak dan memakai bagian yang dicetak.

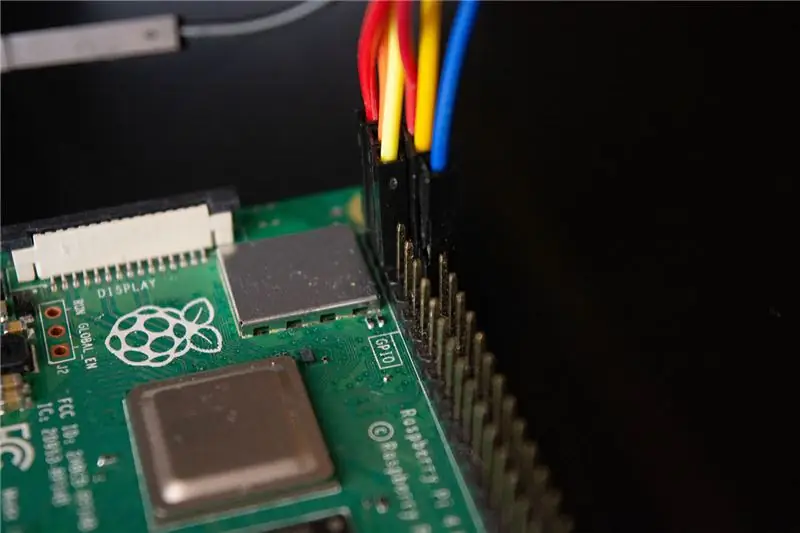

Langkah 5: Menghubungkan Ewon

Kami berada di langkah terakhir untuk membuat Ewon menjadi hidup. Berikut diagram pengkabelan untuk komponen beserta gambar yang menunjukkan koneksi.

- Driver servo terhubung ke pin I2C yaitu SDA dan SCL dari RPI.

- Layar terhubung ke pin RX dan TX dari RPI

- Mikrofon dan speaker terhubung ke kartu Suara USB yang terhubung ke RPI melalui port USB.

Peringatan: Hati-hati dengan korslet RPI Anda. Silakan periksa semua koneksi Anda dua kali dan pastikan Anda tidak melakukan kesalahan. Semua aksesoris yaitu speaker, servo driver, dan display ditenagai oleh baterai 5v terpisah dan tidak menggunakan jalur Raspberry Pi 5v. Raspberry pi hanya digunakan untuk mengirim data ke aksesori tetapi tidak untuk memberi daya.

Langkah 6: Hei Ewon! Bisakah kamu mendengarku?

Jadi kami telah memasang semua aksesori kami dan menginstal semua perpustakaan yang diperlukan. Anda dapat memulai Ewon dengan menjalankan skrip shell menggunakan./run Ewon.shTapi apakah skrip.sh ini? Ewon menggunakan banyak perpustakaan yang berbeda dengan skrip yang berbeda (Google asisten SDK, Snowboy, Adafruit, dll). Semua skrip ditempatkan di folder masing-masing. (Kami dapat memindahkan semua file di jalur yang sama dan mengatur semua skrip, tetapi saat ini, beberapa perpustakaan tidak mengizinkan pemindahan file sumber, jadi, untuk saat ini, kami hanya akan menyimpannya di lokasi masing-masing).sh adalah skrip shell yang menjalankan semua skrip ini satu per satu dari setiap lokasi sehingga Anda tidak perlu secara manual pergi ke setiap lokasi dan menjalankan skrip. Ini membuatnya lebih mudah untuk menangani semua perintah.

Setelah Anda menjalankan skrip shell, katakan saja "Hei Ewon!" dan Anda akan melihat Ewon mulai mendengarkan Anda. Sekarang Anda dapat menggunakan Ewon sebagai asisten google dan berbicara dengannya dan Anda dapat melihat Ewon mengubah ekspresi dari apa yang Anda katakan. Cobalah sesuatu seperti “Hei Ewon! Aku sedih hari ini” dan kamu bisa melihat Ewon sedih bersamamu. Mintalah lelucon pada Ewon dan lihat dia menertawakan lelucon itu.

Langkah 7: Apa Selanjutnya?

Ewon tidak berhenti di sini. Ewon sekarang memiliki cara untuk mendeteksi dan menunjukkan emosi tetapi kita dapat melakukannya lebih banyak lagi. Ini baru permulaan.

Dalam pembaruan yang akan datang, kami akan mengerjakan cara membuat

- Ewon mendeteksi wajah dan melacak wajah Anda dan bergerak mengikuti wajah Anda.

- Kami akan menambahkan efek suara untuk memberikan kedalaman ekstra pada karakter.

- Tambahkan mobilitas agar Ewon bisa bergerak bersama Anda.

Catatan: Karena situasi saat ini, menjadi sangat sulit untuk mendapatkan suku cadang untuk proyek tersebut. Ini membuat saya mengubah desain dan fungsionalitas mengingat pemikiran yang saya miliki dalam inventaris saya. Tetapi segera setelah saya mendapatkan semua bagian, saya akan memperbarui proyek di atas.

Pembaruan:

- Membuat beberapa perubahan dalam kode, menghapus skrip shell.

- Menambahkan badan persegi panjang untuk EWON.

Direkomendasikan:

Waterproof Raspberry Pi Powered Wifi DSLR Webcam untuk Time Lapses: 3 Langkah (dengan Gambar)

Waterproof Raspberry Pi Powered Wifi DSLR Webcam untuk Time Lapses: Saya suka menonton matahari terbenam dari rumah. Sedemikian rupa sehingga saya mendapatkan sedikit FOMO ketika ada matahari terbenam yang bagus dan saya tidak di rumah untuk melihatnya. Webcam IP menghasilkan kualitas gambar yang mengecewakan. Saya mulai mencari cara untuk menggunakan kembali DSLR pertama saya: Cano 2007

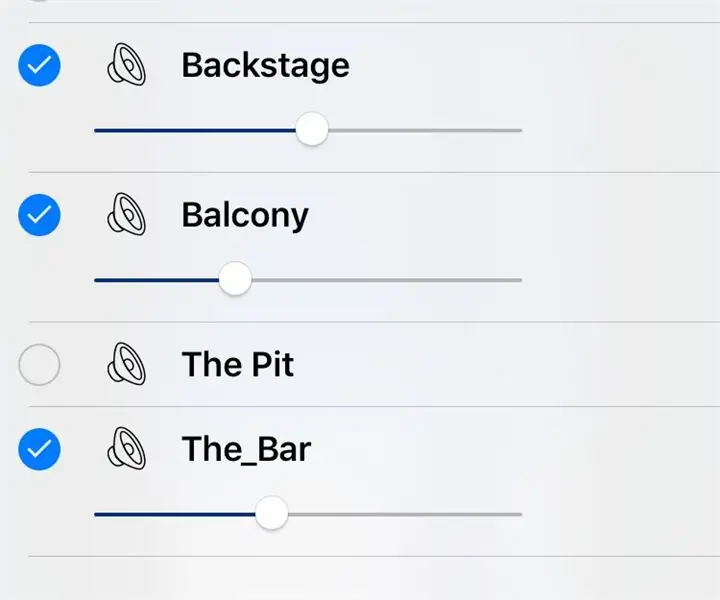

Raspberry Pi Whole Home Synchronous Audio Dengan Remote App Telepon: 10 Langkah (dengan Gambar)

Raspberry Pi Whole Home Synchronous Audio With Phone App Remotes: Tujuannya adalah menyinkronkan audio dan/atau sumber individual di ruangan mana pun, mudah dikontrol dengan ponsel atau tablet melalui iTunes Remote (apple) atau Retune (android). Saya juga ingin zona audio menyala/mati secara otomatis jadi saya beralih ke Raspberry Pi dan

Robot Mentega: Robot Arduino Dengan Krisis Eksistensial: 6 Langkah (dengan Gambar)

Robot Mentega: Robot Arduino Dengan Krisis Eksistensial: Proyek ini didasarkan pada serial animasi "Rick and Morty". Di salah satu episode, Rick membuat robot yang tujuan utamanya adalah membawa mentega. Sebagai mahasiswa dari Bruface (Fakultas Teknik Brussel) kami memiliki tugas untuk mecha

[Robot Arduino] Cara Membuat Robot Penangkap Gerak - Robot Jempol - Motor Servo - Kode Sumber: 26 Langkah (dengan Gambar)

![[Robot Arduino] Cara Membuat Robot Penangkap Gerak - Robot Jempol - Motor Servo - Kode Sumber: 26 Langkah (dengan Gambar) [Robot Arduino] Cara Membuat Robot Penangkap Gerak - Robot Jempol - Motor Servo - Kode Sumber: 26 Langkah (dengan Gambar)](https://i.howwhatproduce.com/images/001/image-1599-93-j.webp)

[Robot Arduino] Cara Membuat Robot Penangkap Gerak | Robot Jempol | Motor Servo | Kode Sumber: Robot Jempol. Menggunakan potensiometer motor servo MG90S. Ini sangat menyenangkan dan mudah! Kodenya sangat sederhana. Hanya sekitar 30 baris. Ini terlihat seperti penangkapan gerak. Silakan tinggalkan pertanyaan atau umpan balik! [Instruksi] Kode Sumber https://github.c

Google Home DIY Dengan Speaker Bluetooth di Raspberry Pi Zero Docking Hub: 7 Langkah (dengan Gambar)

Google Home DIY Dengan Speaker Bluetooth di Raspberry Pi Zero Docking Hub: Kami memiliki instruksi di Amazon Echo Alexa DIY - Asisten Suara Alexa di Raspberry Pi Zero Docking Hub. Kali ini kami ingin menunjukkan cara membuat Google Home DIY. Dalam instruksi ini, kami akan menunjukkan kepada Anda cara menginstal dan mengatur Asisten Google